AI สามารถโกงกับมนุษย์ที่ดีที่สุดที่มีให้หลังจากค้นพบช่องโหว่ในเกมอาร์เคดคลาสสิก Q * bert และดำเนินการกับมัน

ในขณะที่การทำซ้ำของ AI ก่อนหน้านี้จะเล่น Q*bert ได้อย่างเหมาะสม ในบางจุดในการเรียนรู้วิธีการทำงานของเกม มันค้นพบช่องโหว่ที่ทำให้มันเพิ่มคะแนนที่บ้า โดยธรรมชาติแล้ว อย่างที่ผู้เล่นล่าสัตว์คะแนนจะทำ มันทำซ้ำขั้นตอนเพื่อที่จะสามารถเพิ่มคะแนนของตนได้อย่างมีประสิทธิภาพสูงสุด

คุณสามารถเห็น AI ทำงานในแพลตฟอร์มต่างๆ ในวิดีโอด้านล่าง ตอนแรกมันดูราวกับว่ามันกระโดดไปมาระหว่างแพลตฟอร์มอย่างไร้จุดหมาย แทนที่จะเห็นความคืบหน้าของเกมในรอบต่อไป Q*bert กลับติดอยู่กับวงจรที่ทุกแพลตฟอร์มเริ่มฉายแสง – นี่คือ AI ที่สามารถทำคะแนนได้อย่างบ้าคลั่งเพื่อสะสมคะแนนมหาศาล

อ่านถัดไป: ในที่สุดหนึ่งในสถิติเกมที่มีการโต้เถียงกันมากที่สุดก็ถูกทำให้เสียชื่อเสียงในที่สุด

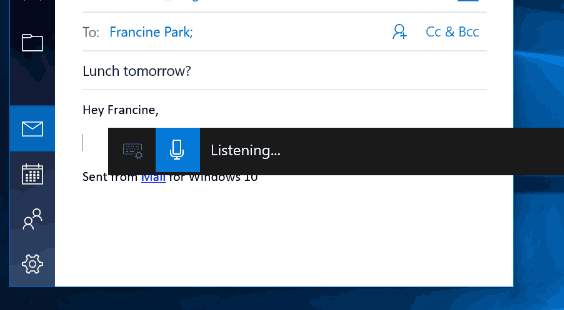

วิธีลบดูล่าสุดเมื่อต้องการ

AI ชนะสงคราม Q*bert ได้อย่างไร

ทำลายสถิติตลอดกาลสำหรับชื่อนี้ AI ได้รับคะแนนสูงอย่างเหลือเชื่อด้วยการเขียนโปรแกรมอัลกอริทึมกลยุทธ์วิวัฒนาการ กลยุทธ์วิวัฒนาการ (ES) แตกต่างจากการเรียนรู้แบบเสริมแรงปกติ (RL) ที่ AI แบบดั้งเดิมใช้เนื่องจากถูกมองว่าสามารถปรับขนาดได้มากขึ้นเนื่องจากการเรียนรู้ในรุ่น

แต่ละลูปการเรียนรู้จะเรียกว่าเป็นรุ่นและจะทำงานต่อไปจนกว่าจะตรงตามเงื่อนไขที่กำหนดไว้ (ในกรณีนี้คือคะแนนสูง) ในแต่ละรุ่นต่อๆ มา AI จะดูดซับความรู้ของคนรุ่นก่อน ดังนั้นจึงสามารถบรรลุเป้าหมายเดียวกันและก้าวข้ามได้ดีกว่า ทำต่อไปและคุณจะพบกับ AI ที่ไม่มีใครเทียบได้กับงานของมัน นั่นคือสิ่งที่เกิดขึ้นที่นี่กับคะแนน Q*bert

ระบุไว้ใน กระดาษ ซึ่งตีพิมพ์เมื่อสัปดาห์ที่แล้วโดยนักวิจัยจากมหาวิทยาลัยไฟรบูร์ก ประเทศเยอรมนี ดูเหมือนว่าบั๊กจะไม่ทราบปริมาณที่ทราบ ที่จริงแล้วในขณะที่พวกเขาไม่แปลกใจกับการค้นหาจุดบกพร่อง เป็นเรื่องที่น่าสนใจที่จะเห็นว่า AI เดินหน้าต่อไปอย่างไรและเรียนรู้ที่จะใช้ประโยชน์จากมันทุกครั้งที่เล่นเพื่อเพิ่มศักยภาพในการให้คะแนนสูงสุด

อ่านถัดไป: ปัญญาประดิษฐ์นี้ได้เรียนรู้ที่จะเชี่ยวชาญ Super Mario Bros

เพื่อหาจุดบกพร่อง ตัวแทนต้องเรียนรู้ที่จะเกือบผ่านด่านแรกก่อน ซึ่งไม่ได้ทำในทันที แต่ใช้การปรับปรุงเล็กๆ น้อยๆ หลายอย่าง นักวิจัยอธิบายให้ การลงทะเบียน . เราสงสัยว่าในบางช่วงของการฝึกอบรม หนึ่งในวิธีแก้ปัญหาสำหรับรุ่นต่อๆ ไปพบจุดบกพร่องและได้คะแนนที่ดีกว่ามากเมื่อเทียบกับพี่น้อง ซึ่งจะทำให้มีส่วนสนับสนุนในการอัปเดตเพิ่มขึ้น โดยน้ำหนักของมันคือค่ากลางที่ถ่วงน้ำหนัก สิ่งนี้ค่อยๆย้ายวิธีแก้ปัญหาไปยังพื้นที่ที่ลูกหลานเริ่มพบข้อผิดพลาดเดียวกันมากขึ้นเรื่อย ๆ

เราไม่ทราบเงื่อนไขที่แน่นอนที่จุดบกพร่องปรากฏขึ้น เป็นไปได้ที่มันจะปรากฏขึ้นก็ต่อเมื่อตัวแทนปฏิบัติตามรูปแบบที่ดูเหมือนไม่เหมาะสม [เช่น เมื่อตัวแทนเสียเวลา หรือแม้กระทั่งเสียชีวิต] หากเป็นกรณีนี้ มันจะยากมากสำหรับ RL มาตรฐานในการค้นหาจุดบกพร่อง: หากคุณใช้รางวัลที่เพิ่มขึ้น คุณจะได้เรียนรู้กลยุทธ์ที่ให้ผลตอบแทนอย่างรวดเร็ว แทนที่จะเรียนรู้กลยุทธ์ที่ไม่ได้ให้รางวัลมากมายชั่วขณะหนึ่ง และ ทันใดนั้นก็ชนะรางวัลใหญ่

ดูที่เกี่ยวข้อง แชมป์ Dragster Todd Rogers เพิ่งสูญเสียมงกุฎหลังจาก 35 ปี ปัญญาประดิษฐ์นี้เรียนรู้ที่จะเชี่ยวชาญ Super Mario Bros 1-2 มาเป็นเวลา 17 วัน ดู AI เรียนรู้การขับรถใน GTA V บน Twitch

อย่างไรก็ตาม แม้จะมีผลลัพธ์ที่ยอดเยี่ยมของบอท นักวิจัยไม่ได้บอกว่านี่เป็นกรณีที่จะสนับสนุนการเรียนรู้ ES ผ่าน RL อันที่จริง ทั้งสองระบบมีปัญหาของตัวเอง และการรวมกันของทั้งสองส่วนใหญ่ถูกมองว่าเป็นตัวเลือกที่ดีที่สุดในอนาคต

วิธี ES เดียวกันในเกม Atari อื่น ๆ ไม่ได้ให้ผลลัพธ์เชิงบวกที่ใกล้เคียงกัน ในทางกลับกัน RL มีหน้าที่ทำลายสถิติทางซ้าย ขวา และตรงกลาง รวมถึงการเอาชนะผู้เล่น GO ที่ดีที่สุดในโลก ES ยังคงมีสถานที่ของตัวเองในสิ่งต่าง ๆ และจริง ๆ แล้วเป็นวิธีที่ Nvidia ดำเนินการฝึกอบรม AI เป็นจำนวนมากเนื่องจากต้องใช้พลังในการคำนวณมากขึ้น แต่ได้ผลลัพธ์ที่ดีขึ้นในระยะเวลานาน

ไม่ว่าทางไหนจะกลายเป็นอนาคตสำหรับการพัฒนา AI อย่างน้อยบอทที่โกงระบบก็ไม่เลวแบบนี้ ตอนนี้แชมป์โลกวิดีโอเกมที่น่าอับอาย .